エッジに高度な音声認識をもたらすスパースAIマイコン:MCUとNPUを統合

Femtosenseは、同社のNPU(ニューラルプロセッシングユニット)とABOV SemiconductorのMCUを統合した、スパースAI(人工知能) MCU「AI-ADAM-100」を開発した。クラウドに接続されていないデバイスでも、エッジに音声言語インタフェースを実装できるという。

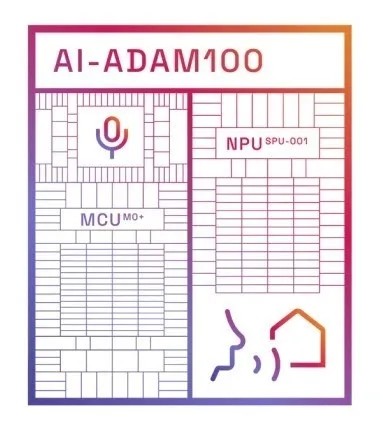

Infineon Technologiesやルネサス エレクトロニクス、STMicroelectronicsのような大手MCUメーカーは、エッジアプリケーションを促進するために自社製チップにAI(人工知能)機能を搭載している。こうした大手メーカーの動きに対し、2社の小規模メーカーが提携し、スパースAI MCUを提供している。Femtosenseは、同社のNPU(ニューラルプロセッシングユニット)である「Sparse Processing Unit 001(SPU-001)」を、ABOV Semiconductor(以下、ABOV)のMCUと統合したという。

その成果として実現した「AI-ADAM-100」は、スパースAI技術をベースとして構築されたMCUで、家電などさまざまな製品の音声ベースの制御のようなオンデバイスAI機能を実現する。クラウドに送信される前に音声/オーディオデータをクリーンアップして、信頼性と精度を向上させ、クラウドに送信されるデータ量を削減できる。設計者はAI-ADAM-100を採用することにより、クラウドに接続されていないデバイスでもエッジに音声言語インタフェースを実装できるようになる。

FemtosenseのCEO(最高経営責任者)であるSam Fok氏は、「AI-ADAM-100は、AI開発スタック全体にスパース性を統合してスパースAIのメリットを完全に解放した、市場初のデバイスだ。スパースAI MCUのターゲットとしては、家電製品の他、高忠実度(high fidelity)の補聴器や産業用ヘッドセット、コンシューマー向けイヤフォンなどの小型フォームファクターの電池駆動式デバイスが挙げられる」と述べている。

スパースAIはどのように機能するのだろうか。スパースAIは、アルゴリズムとは無関係の部分の重みをゼロ化し、アルゴリズムと関係がある非ゼロの部分にのみハードウェアメモリと計算リソースを割り当てることで、AI推論のコストを削減する。その結果、非ゼロの重みだけを保存/計算するシステムは、速度と効率、メモリフットプリントを最大で10倍高めることが可能だ。

家電メーカーはAI-ADAM-100を採用することで、非常に高性能なウェイクアップ/制御機能を実装できるようになる。これにより、他のシステムコントローラーやコネクティビティモジュールをスリープモードに落とすことで、ユーザーがシステムとやりとりしていない場合の消費電力量を大幅に削減することができる。さらにABOVは、AI-ADAM-100の音声コマンド認識性能をさまざまなノイズ条件下で検証している。

AI-ADAM-100は、現在進められているAIとMCUの融合に、新たな特色を追加している。MCUに言語処理機能と音声クリーンアップ機能を提供し、スパース(疎)/デンス(密)を問わずメーカー独自のAIモデルと連携することが可能だ。

【翻訳:田中留美、編集:EDN Japan】

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

マイコンの仕様を超える条件で使ったら、何が起きる?【前編】

マイコンの仕様を超える条件で使ったら、何が起きる?【前編】

本記事では、マイコンにストレスを与え続けて動作させた場合、どのような不良現象が現れるかを2回にわたり詳しく解説する。第1回となる今回は、最初に「マイコンにストレスを与える環境」について、次に「高温、高湿、高電圧状態で発生する不良現象とメカニズム」として「故障モード」「不良現象のメカニズム」について説明する。 マイコン製品出荷時に実施されているテスト内容

マイコン製品出荷時に実施されているテスト内容

前回に引き続き、マイコン製品の出荷時にどのようなテストが行われているかを詳しく解説する。今回は、前回概要を解説した以下のテストについて、具体的な方法と詳細について紹介する。 Wi-Fi 6E、BLE対応のコネクテッドMCU

Wi-Fi 6E、BLE対応のコネクテッドMCU

インフィニオン テクノロジーズは、コネクテッドマイクロコントローラー「AIROC CYW5591x」ファミリーを発表した。Wi-Fi 6とWi-Fi 6E、Bluetooth Low Energy 5.4を統合している。 デジタル回路とアナログ回路の違いって何? 内部構成や仕組みを解説

デジタル回路とアナログ回路の違いって何? 内部構成や仕組みを解説

マイコンユーザーのさまざまな疑問に対し、マイコンメーカーのエンジニアがお答えしていく本連載。今回は、初心者の方からよく質問される「デジタル回路とアナログ回路の違い」についてです。