「CES 2025」から見る車載半導体トレンド:置き去り検知や機械学習に注目(2/2 ページ)

自動車メーカーの設計アプローチが従来のドメインアーキテクチャからゾーンアーキテクチャへと移行する中、センサー機能の最適化や、マルチモーダル入力データと機械学習(ML)とを融合させた状況認識が推進されている。本稿では、「CES 2025」で展示された車載向けのソリューションを紹介する。

自動運転向けサラウンドビューカメラ

自動運転/ADAS向けの車載用サラウンドビューカメラも多くのブースで展示されていた。下図のように、Microchipのシリアライザーは最大伝送速度8Gbpsの3台のカメラに搭載されている。同社のデシリアライザーは、ビデオデータを受信して、車載ネットワークのオープンスタンダードであるASA Motion Link(ASA-ML)を介して中央コンピュータまたは高性能コンピューティング(HPC)に集約するよう構成され、ゾーンアーキテクチャを模倣している。

ADIは、シリアライザー/デシリアライザー(SerDes)ソリューションを展示し、独自の伝送技術「Gigabit Multimedia Serial Link(GMSL)」のデモを披露した。GMSLの特徴は軽量さだ。1本の双方向ケーブルで最大12Gbpsのデータを伝送し、重量削減に貢献する。

視覚言語モデルを用いた状況認識も

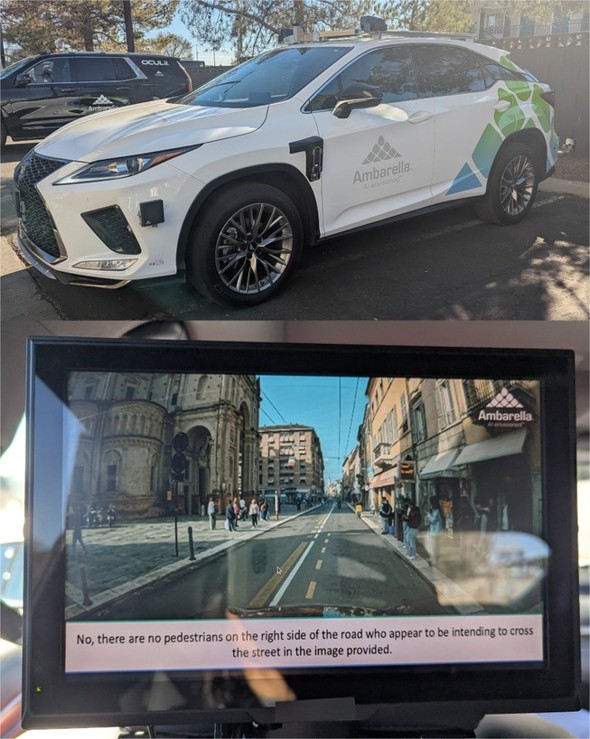

ビジョンAI向けプロセッサを手掛けるAmbarellaは、スタックに大規模言語モデル(LLM)を統合したデモを披露した。この技術は、2015年にAmbarellaが買収したイタリアのスタートアップであるVislabによって開発されたものだ。

このシステムは6台のカメラと5台のレーダー、そして自動運転レベル2+〜レベル4対応の自動車ドメインコントローラー「CV3」で構成されている。視覚言語モデル(VLM)「LLaVA-OneVision」によって、より高度に状況を踏まえた意思決定が可能になった。

CES 2025ではVislabの創設者であるAlberto Broggi氏がデモを紹介し、自動車に大規模言語モデル(LLM)を活用する利点について説明した。

「仮にあなたが世界最高の知覚力を持っていて、あらゆるものを知覚でき、車の位置を把握したり、歩行者を見つけたりできるとする。それでもなおあいまいな状況があって、問題は残る。自分の車線の前に車がいたとしたら、追い越しができるかどうかは状況次第だ。だから、より高度な状況把握が必要なのだ」(Broggi氏)

【翻訳:田中留美、編集:EDN Japan】

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

車載プロセッサで採用が進む、サイバーセキュリティ規格「ISO 21434」

車載プロセッサで採用が進む、サイバーセキュリティ規格「ISO 21434」

自動車設計の機能安全基準「ISO 26262」が幅広く採用されたのに続き、悪意のあるサイバー攻撃からコネクテッドカーを守るための国際標準規格である「ISO/SAE 21434」も定着しつつある。 ゾーンアーキテクチャとイーサネットが自動車の将来を推進

ゾーンアーキテクチャとイーサネットが自動車の将来を推進

自動車の新機能採用やソフトウェア定義型自動車(SDV)などの成長中のトレンドを実現するために必要なゾーンアーキテクチャおよびイーサネットについて解説します。 幼児の置き去り検知など、車載向けシングルチップUWBファミリー

幼児の置き去り検知など、車載向けシングルチップUWBファミリー

NXPセミコンダクターズは、車載向けシングルチップUWBファミリー「Trimension NCJ29D6」を発表した。セキュアなカーアクセスや侵入警告、幼児の置き去り検出などに対応する。 自動車設計の進化で電子部品への要求はどう変わる?

自動車設計の進化で電子部品への要求はどう変わる?

電動化が進む自動車の設計において、車載用エレクトロニクスに対する要求はどう変化しているのだろうか。コネクターなどを手掛けるMolexと、半導体/電子部品ディストリビューターのDigiKeyが解説する。 厳しい機能安全要求に対応するアナログTMR角度センサー、車載/産機向け

厳しい機能安全要求に対応するアナログTMR角度センサー、車載/産機向け

TDKは、自動車や産業機器向けに、アナログTMR(トンネル磁気抵抗)角度センサー「TAS8240」を開発した。4組のTMRハーフブリッジを備え、x-y平面に回転磁界を印加することで、独立した4組のシングルエンド正弦および余弦を同時出力できる。