AI分野で欠かせないGPUとは? CPUとの違いや活用例まで解説:改めて知りたいGPUの基本(2/2 ページ)

3. AIの推論にGPUが適している理由

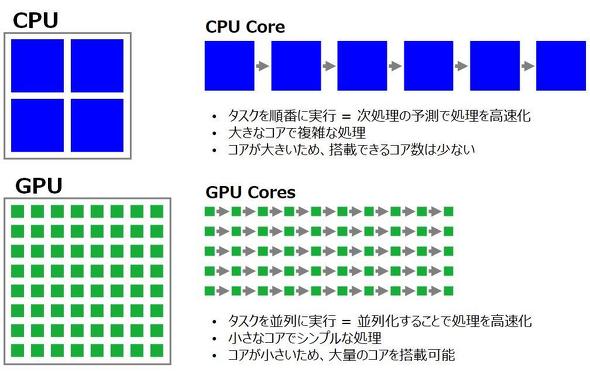

AIの推論、特にニューラルネットワークの推論処理は膨大な数の演算を必要とし、CPUでは処理が追い付かない場合があります。GPUは、多数のコアを用いてAIの計算処理を並列に実行できるため、CPUに比べて高速に処理を行えます。

例えば、カメラの映像から物体を識別したり、音声データから言葉を認識するAIの推論処理では、ニューラルネットワークが莫大な計算を一度に実行する必要があるため、GPUを活用した並列処理によって、CPUの逐次処理よりも大幅な処理速度の向上が期待できます。

次章では並列処理の詳細について説明します。

4. 並列処理による高速化とは?

例えば、画像をAIが見て何が写っているか判断する時、

- 画像の中のピクセルを数値に変換

- その数値に対して「重み」をかける(行列演算や畳み込み演算)

- 結果をまとめて次の処理に渡す

……というように、大量の計算を一気に処理する必要があります。

この計算を並列処理で高速化するためには、GPGPUという技術があります

(1)GPGPUとは?

「General-Purpose computing on Graphics Processing Units」の略で、もともとグラフィックス処理用だったGPUを、AI推論や科学技術計算などの一般的な計算処理に活用する技術です。

その中でも、NVIDIAが提供するCUDAという開発プラットフォームがあります。これはGPUの演算能力を効率的に引き出すためのツールで、行列演算や畳み込みといったAIに必要な処理を高速に実行できます。

PyTorchやTensorFlowなどの主要なAIライブラリでも内部的にCUDAが使われており、ユーザーは複雑な並列処理を意識せずに、高性能なAI処理を簡単なコードで実現できます。

ちなみに、OpenCLという汎用的な並列処理の仕組みもあり、NVIDIA以外のGPUやFPGAでも動作します。ただし、AI用途ではCUDAの方が高速で、開発ツールも充実しているため、現在ではOpenCLが使われるケースは少なくなっています。

※グループ会社の菱洋エレクトロでは、主にCUDAに最適化された 「Jetsonシリーズ(Jetson AGX Orin、Jetson Orin Nanoなど)」 を提供しています。

GPUはロボット制御にも用いられています。NVIDIA JetsonとIsaacプラットフォームを使用したロボット制御に関しては、こちらの記事で詳しく紹介しています。あわせてご覧ください。

最新GPUを搭載し、AIを構築および実行するために設計されたパーソナルAIコンピュータ「NVIDIA DGXTM Spark」もリリースされています。NVIDIA DGXTM Sparkに関しては、こちらの記事で詳しく紹介しています。

5. まとめ

今回は、GPUの基本構造から、その並列処理の仕組み、CPUとの違いや得意な処理領域、さらにはAIや画像処理における活用例まで幅広く紹介しました。

GPUは、その高い並列処理能力により、画像処理やAIなどの大量のデータを一括で処理するタスクに最適です。特にAIの分野では、学習モデルの高速化やリアルタイム推論を可能にし、ソリューションの価値を大きく引き上げる重要な技術要素となっています。

一方で、全ての処理にGPUが適しているわけではなく、制御系や逐次処理のようにCPUが得意とする領域もあります。そのため、GPUとCPUを適切に使い分けることが、システム全体の最適化には欠かせません。

「自分たちの業務にGPUが使えるのか?」「AIを動かすにはどれくらいの性能が必要なのか?」そんな疑問を持った方にとって、本記事がGPU導入・活用の第一歩となれば幸いです。

リョーサンテクラボには、GPU以外にもさまざまなテーマのコンテンツを掲載していますので、のぞいてみてください。

関連記事

EMIの基礎

EMIの基礎

今回は「EMI(電磁妨害)」を取り上げます。EMIの定義から、EMIが与える影響、EMIで使われる単位といった基礎知識をお伝えします。 初めは“ノイズ”じゃなかった

初めは“ノイズ”じゃなかった

電子機器製品とは切っても切り離せないノイズ・EMCについて、電磁気の超基礎からEMC現場で実際に行われている対策まで、全4回の連載で分かりやすく解説します。 影のごとく付きまとうノイズ

影のごとく付きまとうノイズ

今回は、電気と磁気の関係について解説します。また、自分自身からのノイズで機械の誤動作を引き起こす事象なども紹介します。 スペクトラム拡散で電源回路のEMIを低減

スペクトラム拡散で電源回路のEMIを低減

スイッチング電源は雑音の発生源として悪名が高い。いわゆるスイッチング雑音を発生するからだ。この雑音は配線パターンなどを介して放射電磁雑音(EMI)となり、電源回路の外部の周辺回路などに飛び込む。対策としては、EMIフィルターを使う方法が考えられるが、実装に要する基板面積が大きくなり、部品コストも増えてしまうため難しい。そこで、今回は、スイッチング電源のスイッチング周波数を変調することで、EMIを低減する方法を紹介する。 磁界測定の基本を押さえる

磁界測定の基本を押さえる

計測装置に代表される高性能機器の開発時には、ノイズ対策に注意を払わなければならない。例えば、システムの構築に必須のDC-DCコンバータが、EMIノイズの発生源となることは周知の通りだ。本稿では、DC-DCコンバータの磁界測定の実例を示しながら、EMI対策を行うために必要となる基本的な知識をまとめる。 データシートの勝手な解釈は禁物! いま一度、数字の意味を考えよう

データシートの勝手な解釈は禁物! いま一度、数字の意味を考えよう

データシートの読み方編の最終回となる今回は、マイコン製品のデータシートのうち、「フラッシュメモリ特性」「ラッチアップ、EMS、EMI、ESD」「汎用I/O」「リセット回路特性」「通信機能特性(SPI)」「A-Dコンバーター特性」の項目について解説していく。

関連リンク

Copyright © Ryoyo Ryosan, Inc. All rights reserved.

記事ランキング

- マイコンの通信機能 UARTとI2C 、SPIの違い

- 校正やテストに使える 2線式ループ電流発生器を作ってみた

- 「分解能0.1%」の静電容量式位置センサーを構成する

- ダイヤモンド半導体用2インチウエハー量産へ モザイク結晶開発に成功

- 熱間加工磁石で材料ロス低減 EVモーター用ローター

- ON/OFFコンバーターの制御不安定問題(3)状態平均化法での結果と安定化動作に必要な位相/利得

- 次世代データセンター向け1200V SiC MOSFET、オン抵抗58%削減

- NAND/NORフラッシュメモリの違いと記録方式を分かりやすく解説

- 車両のコア機能を「一元管理」 NXPの新車載プロセッサ

- ARM台頭にルネサス誕生……時代に翻弄され続けた日立「SuperH」